TurboQuant 對記憶體需求的啟示:從 KV Cache 壓縮看 AI 推論的供需變化

以下內容只從技術與產業研究角度作教育性分析,用於說明研究框架,不構成任何投資建議。

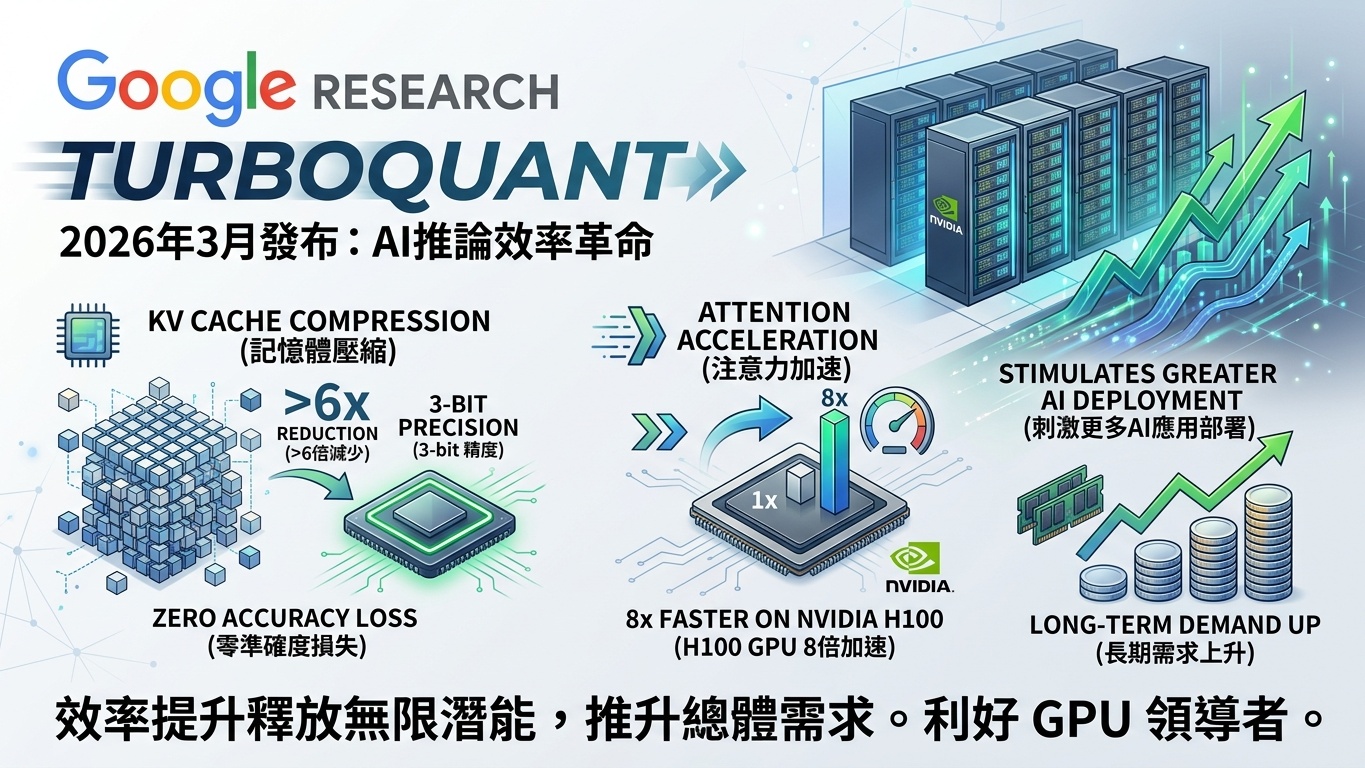

Google Research 於 2026 年 3 月發布的 TurboQuant 演算法,迅速引起廣泛討論。這項技術能把大型語言模型(LLM)的 Key-Value(KV)Cache 記憶體大幅壓縮,在部分測試中甚至可達 3-bit 精度,並在 NVIDIA H100 GPU 上呈現明顯的注意力運算加速效果。

不少人的第一反應是:如果記憶體效率顯著提升,是否代表 DRAM、高頻寬記憶體(HBM)以及整體 RAM 需求都會明顯下滑?這個問題值得研究,但若只停在「需求會不會變少」,往往過於簡化。更完整的理解方式應該是:TurboQuant 的確可能在短期內降低單一推論任務的記憶體占用,但長期結果仍取決於推論應用滲透速度、總工作負載成長,以及整個 AI 系統如何重新分配資源。

一、TurboQuant 的本質:針對 KV Cache 的極致優化

TurboQuant 主要針對 KV Cache——也就是 Transformer 架構在自回歸生成過程中,用來儲存先前 token 鍵值對的暫存記憶體。隨著對話長度或上下文增加,KV Cache 往往成為推論階段的最大記憶體消耗來源之一。若能把這部分壓縮到更低精度,同時維持可接受的準確度,就能大幅減少運行時所需的 RAM/DRAM 容量。

在短期內,這種針對性壓縮確實可能緩解 RAM/DRAM 的即時壓力:

- 在長上下文或高並行用戶情境下,KV Cache 可占據相當高比例的記憶體。

- 壓縮後,相同硬體能處理更長上下文或更多並行請求,而無需立即擴充記憶體。

- 但這並非代表所有記憶體需求都會同步下降,因為模型權重、激活值、向量資料庫(RAG)以及訓練與 prefill 階段,仍然需要大量頻寬與容量。

因此,更準確的說法是:TurboQuant 主要解決了推論階段其中一個關鍵瓶頸,而不是「一招解決所有記憶體問題」。

二、短期需求緩解 vs. 長期 Jevons Paradox

雖然短期內 TurboQuant 能降低單次推論的記憶體足跡,但 AI 產業的長期趨勢未必因此轉弱。這裡可以借用 Jevons Paradox(傑文斯悖論)的思路:效率提升不一定永久壓低資源消耗,反而可能刺激更多使用。

-

短期現實:單位任務更省資源 KV Cache 壓縮與注意力運算加速,意味著許多現有部署可用更少 RAM 運行相同工作負載。對邊緣裝置、企業私有化部署或成本敏感場景來說,這會直接改善可行性。

-

長期變化:推論變便宜,應用可能更快擴散 當推論成本下降,企業更可能部署 AI Agent、多模態應用、即時系統與程式碼生成等服務。商業模式也可能由「少量高成本模型」轉向「大規模、持續運行的推論服務」。

-

總量效果未必下滑 即使單次任務所需記憶體下降,只要總 token 吞吐量與應用頻率同步上升,整體 DRAM/RAM 需求仍可能維持高位,甚至在更大基數上成長。

換言之,TurboQuant 對需求的影響,應分開看「單位成本」與「總量成長」,兩者並不一定同方向變化。

三、為何 GPU 平台通常會率先受益?

這類效率優化通常會先在 GPU 平台上展現效果,原因主要有三:

- 效率能放大既有硬體能力:TurboQuant 在 NVIDIA H100 等 GPU 上展現較高加速效果,代表相同 GPU 資源可承載更多工作負載或更長上下文。

- 推論規模化仍高度依賴並行運算:即使記憶體占用下降,推論時代對吞吐量、延遲與軟體整合的要求依然很高,GPU 仍是關鍵基礎設施之一。

- 軟體生態決定落地速度:CUDA、生態工具鏈以及各種推論框架,會影響新演算法能否迅速被整合進真實部署。這也是為何技術突破不只看論文本身,還要看平台兼容與落地速度。

這裡的重點不是判斷某一家公司應如何評價,而是理解:當演算法效率進步時,硬體平台的角色往往不會消失,而是改變資源分配與使用密度。

四、結論:效率革命改變的是配置方式,不只是需求方向

TurboQuant 是一項相當重要的演算法創新,它有助解決 LLM 推論中的 KV Cache 瓶頸,在短期內確實可能降低 RAM/DRAM 的即時需求,讓更多部署變得可行且更有效率。然而,這不代表記憶體或 GPU 的長期需求會被簡單削弱。

更值得研究的,是 AI 產業會否因為這類技術而進一步由「昂貴、少量的推論」走向「便宜、普及、持續運行的推論」。如果答案是肯定的,那麼資源需求的問題就不再只是「每次要用多少」,而是「整個社會會因此多用多少次」。

AI 的未來不只是少用資源,而是用更少的單位資源完成更多任務。TurboQuant 的意義,也正在於它把這種轉變推得更前一步。

免責聲明: 本文內容僅供一般研究參考、教育用途與歷史案例討論,用於整理公司資料、業務變化或市場脈絡,不構成任何形式的投資建議、招攬、買賣訊號或個人化交易指示。Stock Fundamentals Lab 並非證監會持牌機構,文中不提供目標價、入市時機或買賣建議。股市有風險,請自行審慎評估並按需要諮詢持牌專業顧問。